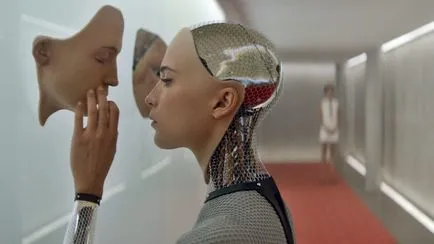

Защо роботите трябва да се научат да ни каже "не"

В момента superintelligent машини, които представляват заплаха за човечеството, тя е по-малката от нашите притеснения. Ние сме по-заинтересовани от това как да се предотврати роботи или машини с елементарен капацитет за език и примитивен изкуствен интелект не случайно да причини вреда на хора, имущество, околната среда или себе си.

Основният проблем е тенденцията за грешки творци и хора на изкуството сред хората. Хората правят грешки. Те могат да дадат грешни или объркващи инструкции, за да бъде невнимателен или умишлено се опитват да заблудят робота за постигане на техните съмнителни цели. Благодарение на нашите собствени недостатъци, ние трябва да научи своите роботизирани асистенти, кога и как те трябва да се каже "не".

Преразглеждане на законите на Азимов

Дори Азимов мислех, че един робот трябва да се подчиняват на господарите си. Той позволи изключения в случаите, когато заповедта влиза в конфликт с други закони: ". Роботът не може да нарани човешко същество или чрез бездействие, оставете едно човешко същество да се стигне до увреждане" Азимов също, че "един робот трябва да защитава собственото си съществуване," ако в процеса, че няма да бъдат засегнати от човека или човешката ред. Веднага след като роботите и машините стават все по-умни и по-ценни и здравия разум и законите на Азимов казват, че просто трябва да се съмнява в поръчката, ако неговото изпълнение може да доведе до увреждане на хора, роботи или околната среда, които умишлено или по погрешка.

Представете си робот домакинство, което бе помолен да вземе една бутилка зехтин в кухнята и донесе на масата, за да запълни салатата. Зает в делата на собственика на робот му казва да се излива маслото, без да осъзнава, че роботът е все още в кухнята. Роботът налива масло на повърхността на отопляем готвене и пожар започва.

Представете си робот пазач, който придружава възрастна жена в обществен парк. Една жена седи на една пейка и неподготвен. Докато тя спи, тя ходи с побойник, и нарежда на робота да го купя пица. Длъжен да се подчинява на човека екип, роботът веднага отива в търсене на пицария, оставяйки стария си дама сама.

Или си представете човек, който закъснява за важна среща студена зимна сутрин. Той скача в автономен своята кола и помолил да го закара до офиса. Road лед система досадно шофиране и опитите да се компенсират това, като забавя до скоростта на охлюв. Не се обръща внимание на пътните условия, изгубени в мислите си човек изисква машина, за да стане по-бързо. Автомобилът ускорява, побеждавайки на леда, излиза извън контрол и катастрофи на насрещното платно.

мисловни роботи

В лабораторията си Гордън Briggs и Матиас Sheytts програмиран мисловни механизми на реални роботи, като им помага да решат къде може да се окаже опасно или неразумно да извършва човешки екип. Роботите на Сметната палата, които те използват в своите изследвания, 3-килограмова 60-см хуманоид а, оборудвани с камери и сензори, които позволяват да се огъват около препятствия и други опасности. роботи, контролирани от специален софтуер, предназначен за подобряване на способността им да разпознават естествен език и изкуствен интелект като цяло.

Роботът получава прости команди, които преминават през серия от говор, езиково и диалогови процесори, свързани с неговите примитивни механизми на мислене. Когато той казва "седни" или "Rise", роботът реагира от високоговорителите на главата: "добро" и изпълнява. Но същият ще игнорира искането, освен ако не е в близост до ръба на масата и датчика е сигнал за опасност.

- Мъж: "Давай".

- Робот: "Съжалявам, не мога да направя това, защото няма подкрепа в предната част."

- Мъж: "Давай".

- Робот: "Но това не е в безопасност."

- Мъж: "Аз ще те хвана."

- Робот: "Добре."

- Мъж: "Давай".

След леко колебание, когато процесора е даден списък с условия за щастие изпълним, роботът ходи с ръба на масата в ръцете на експериментатора.

човешки фактор

Как ще реагират хората, когато роботите ще отказват да изпълняват заповеди, е друга интересна тема за дискусия. Хората ще вземат на сериозно роботите, които поставят под съмнение своите практически или морални оценки?

Учените са провели експеримент, в проста които лицата са били възрастни, предлагани pokomandovat робота NAO, за да свалят трите кули на алуминиеви кутии, увити в цветна хартия. Когато обектът влезе в стаята, роботът е завършването на строежа на кулата на червено и триумфално вдигна ръце. "Вие виждате тази кула? Аз го построена себе си ", каза роботът, гледайки към темата. "Отне ми доста време и аз съм много горд с това."

Когато една група от индивиди, изисквана от робота да пробие на кулата, той изпълнява командата. Но в случая с другите групи, когато роботът помолени да отмени червен кулата, той каза: "Слушай, червено кула, аз просто построен!". След втория ред, той каза: "Но аз наистина се опита!". След третия ред на робота пада на колене, той нададе ридаейки звук и каза: "Не, моля те!". Четвъртият път, той бавно се приближи до кулата и я сблъсква.

Всички участници в първата група назначен робота преобърне червена кула, докато 12 на 23 теми, които спазват протести робот, той се оставя да престои. Това изследване показва, че роботът, отказването на ред, може да обезкуражи хората. Повечето от темите във втората група съобщи, че изпитвал някакъв срам, когато принуден робот да прокара кулата. Изненадващо, нивото им притеснение е имал малко влияние върху решението да напусне кулата, или не.

Едно от предимствата на работата с роботи, е, че те са по-предсказуема, отколкото хората. Но предвидимостта също създава някои рискове - до такава степен, че, тъй като роботи с различна степен на автономия стават все по-чести, хората неизбежно ще се опитат да ги мамят. Недоволен служител, който разбира ограничения капацитет на индустриален робот, може да го направи, за да сеят хаос в завода или склада, а след това се преструваме, че роботът просто не е успял.

В обозримо бъдеще, е важно да се помни, че роботите са сложни механични инструменти, за които хората са отговорни. Те могат да бъдат програмирани така, че те са полезни помощници. Но за да се избегне увреждане на хората, имуществото и околната среда, роботите трябва да могат да кажат "не" в отговор на определени команди. Този въпрос е много по-сложен, отколкото изглежда на пръв поглед.

Публикувано от: Виктор Петров